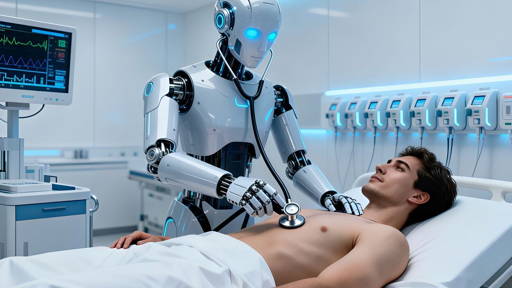

Vertrouwen, betrouwbaarheid, transparantie: woorden die schetsen waar het mondiaal eerste AI-ethieklab voor de zorg zich op richt. Het Erasmuc MC en de TU Delft, met ondersteuning van SAS, lanceerden afgelopen juni het Responsible and Ethical AI in Healthcare Lab (REAiHL). Mede-initiatiefnemers dr. Michel van Genderen (Erasmus MC) en prof.dr. Jeroen van den Hoven (TU Delft) willen er zo in samenwerking met technologieleverancier SAS voor zorgen dat kunstmatige intelligentie veilig ingezet kan worden in de zorg. De komende drie tot vijf jaar moet REAiHL helpen om een framework te ontwikkelen waaraan een AI-model moet voldoen voordat het ethisch verantwoord kan worden toegepast.

Innovatie gaat vooral om slim gebruik maken van data, onder meer via AI. Maar hoe kunnen we dat veilig en uitlegbaar doen? Het was voor Michel van Genderen, internist-intensivist in het Erasmus MC, reden om zich in te zetten voor een AI-ethieklab. Samenwerking met de TU Delft, dat al een eigen digitaal ethiekcentrum heeft, lag voor de hand. En SAS, dat zich al langer met de ethische impact van AI bezighoudt, kwam ook al snel in beeld.

Belangrijkste vraagstukken ethieklab

Wat zijn de belangrijkste vraagstukken die het lab oppakt? Van Genderen noemt de bekende problemen: toename van zorgvraag en afname van personeel. “Dat wordt in de toekomst nijpender. We investeren al veel in personeel, maar snel meer mensen opleiden is moeilijk en biedt geen totaaloplossing. Dat betekent dat we ons moeten verdiepen in hoe technologische innovaties ons kunnen helpen om de huidige zorg te kunnen blijven leveren.

Ook data en AI zijn ‘hot topics’, stelt Van Genderen. “Als we datamodellen, veilig, verantwoord en uitlegbaar willen toepassen, bijvoorbeeld hoe een zorgprofessional AI-inzichten in zijn of haar advies inpast voor een behandeling, moeten we nu al bedenken hoe we dit doen - maar ook hoe we dit kunnen uitleggen aan patiënten en collega’s. “

SAS benadrukt dat het in de samenwerking meer wil doen dan technologie leveren. “We vinden het belangrijk dat we met al onze internationale kennis en ervaring van AI kunnen bijdragen aan de maatschappelijke opdracht die de TU Delft en het Erasmus MC hebben”, stelt Antonie Berkel, account executive Healthcare bij SAS. “Door onderzoekers te faciliteren die ethische vraagstukken gaan onderzoeken. Maar ook door onze kennis en ervaring met vergelijkbare initiatieven uit de zorg en daarbuiten te delen, meedenken in een flexibele schil om het Lab heen.”

Bias en vertrouwen

Meer algemene uitdagingen die het ethieklab wil oppakken, zijn het tegengaan van vooroordelen (bias) in algoritmen en het zorgen voor voldoende vertrouwen in de herkomst van AI-toepassingen (zoals transparantie in hoe uitkomsten tot stand komen).

“Het probleem van bias door bijvoorbeeld onvoldoende representatieve data speelt overal, niet alleen in de zorg, benadrukt Jeroen van den Hoven, hoogleraar techniek en ethiek aan de TU Delft. “Maar ook vertrouwen is cruciaal, wil AI goed gebruikt worden.”

Van den Hoven onderscheidt daarbij wat in de Engelse taal ‘confidence’ en ‘trust’ heet. Confidence gaat om betrouwbaarheid van een toepassing. Doet het wat het belooft, binnen een afgekaderd raamwerk? Dat kan net zozeer gelden voor een lift. Daarnaast heb je moreel vertrouwen (trust). “Puur ter voorbeeld: de loodgieter die jouw waterleiding repareert. Je hebt functioneel vertrouwen (confidence) – is hij een vakman – en moreel vertrouwen – kun je vertrouwen dat hij je zilverwerk niet uit de keukenla meeneemt?”

Lees het hele artikel in ICT&health 5, die op 26 oktober verschijnt.