AI-toepassingen bieden kansen om de zorg beter en efficiënter te maken. Maar er zitten ook haken en ogen aan. Hoe zit het bijvoorbeeld met de aansprakelijkheid als verkeerde voorspellingen leiden tot medische fouten? En wat als voorspellingen die achteraf juist bleken, zijn genegeerd? Deze vragen stonden centraal tijdens de bijeenkomst van het Netwerk AI van de Federatie Medisch Specialisten in Utrecht, waar ruim 100 medisch specialisten uit het hele land bij elkaar kwamen.

Met betrekking tot het onderwerp aansprakelijkheid vergeleek Nynke Vellinga, postdoconderzoeker aan de Rijksuniversiteit Groningen, het gebruik van AI in de zorg met zelfrijdende auto’s. Vervolgens gaf ze een overzicht van de juridische kaders die hier betrekking op hebben, waaronder ook de aanstaande Europese AI-verordening, die eerder dit jaar werd goedgekeurd. Deze verordening biedt kaders voor bijvoorbeeld risicobeheer, transparantie, de rol van menselijke tussenkomst en zorgvuldig handelen. “We moeten door veel hoepeltjes springen om te waarborgen dat we verantwoord bezig zijn met AI. De nieuwe verordening geeft weliswaar al wat meer duidelijkheid, maar dan nog verschilt het van situatie tot situatie wie er aansprakelijk is bij medische fouten”, aldus Vellnga.

Complexe kwestie

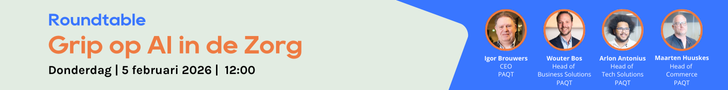

Aansprakelijkheid bij AI is dus een complexe kwestie. Dat bleek ook uit de ronde tafel met vertegenwoordigers vanuit de artsen, ziekenhuisbesturen, patiënten, Inspectie Gezondheidszorg en Jeugd (IGJ), het ministerie van Volksgezondheid, Welzijn en Sport (VWS) en het gezondheidsrecht. Aan de ronde tafel kwamen twee casussen aan bod: een situatie waarbij een vrouw ten onrechte is onderzocht op verdenking van borstkanker, en een casus waarbij generatieve AI een cruciaal gegeven over een patiënt niet opnam in de samenvatting van het patiëntendossier. Wie is er dan verantwoordelijk?

Het antwoord daarop is niet eenduidig. Misschien was het AI-systeem getraind met verkeerde data. In dat geval zou je kunnen stellen dat de fabrikant aansprakelijk is. Maar dan nog moet je als arts bij twijfel ook altijd je eigen oordeel toetsen. Essentieel is dat de arts kan aantonen dat er zorgvuldig is gehandeld en dat hij of zij op de hoogte is van de mogelijkheden en beperkingen van de AI-systemen die kunnen worden ingezet. In dat opzicht kan het gebruik van AI op dezelfde manier worden benaderd als het gebruik van de reguliere medische hulpmiddelen.

Niet 100% foutloos

AI is een hulpmiddel om wat dichter bij de waarheid te komen, maar altijd met marge van onzekerheid. De maatschappij wil echter graag zekerheid. Volgens juristen is net dat hetgeen wat AI juridisch lastig maakt. Ze zeiden hierover: “Onzekerheid botst dan eigenlijk met rechtszekerheid. Als wetgever moet je daar een redelijk midden in zien te vinden.”

De ethicus aan de ronde tafel wierp tegen dat we de zorg niet onnodig moeten juridiseren. Artsen werken tenslotte altijd al met onzekerheden en in dat opzicht is het werken met AI niet heel anders. AI werkt niet 100% foutloos, maar artsen ook niet. Belangrijk is ook dat we het menselijke aspect niet uit het oog verliezen. In de spreekkamer moet het gaan over ziekte en herstel, niet over procedures. De artsen waren het hiermee eens: “We kunnen niet arts én jurist zijn. AI moet het werk makkelijker en efficiënter maken en niet ingewikkelder door alle regels eromheen.”

Niet afwachten

Alle aanwezigen waren het erover eens dat afwachten tot AI wat verder is doorontwikkeld geen optie is. Artsen moeten volgens hen het voortouw nemen: “Anders gaan de grote techbedrijven uit China en de VS straks de norm bepalen en dan is het maar afwachten wat je krijgt. We moeten niet bang zijn om AI te gebruiken en nu de kans grijpen om zelf kennis op te bouwen en te leren. Wel moeten we altijd kritisch en zorgvuldig blijven en transparant zijn richting de patiënt over het gebruik van AI.”

Het is dan wel cruciaal dat er een veilige en open werkomgeving is waar fouten besproken kunnen worden en als leermomenten kunnen worden gezien, zonder angst voor claims. Het is aan het ziekenhuisbestuur om dat mogelijk te maken. Ook moeten ziekenhuizen zorgen voor goede AI-systemen, tijdige software-updates, de juiste expertise en het trainen van personeel.

Meedenken over AI in de zorg

Ook Vilans ziet ethische en sociale uitdagingen, ondanks de kansen die het gebruik van AI in de zorg biedt. De kennisorganisatie voor zorg en ondersteuning wil de zorgsector ondersteunen om op een bewuste manier met deze ontwikkelingen om te gaan. Daarom zoekt Vilans zorgorganisaties die willen meedenken en willen werken aan concrete stappen voor de praktijk.